中国とシンガポールの研究グループが発表した論文によると、大規模言語モデルのGPT-4VとCRADLEと呼ばれるフレームワークを使用して、オープンワールドゲーム「レッドデッドリデンプション2」をチャプター2の途中まで進めることに成功したという。

画面情報と音声情報のみから状況を推測して行動

この研究は、ゲームプログラムから直接情報を受け取らずに、人間がプレイする時と同様、ゲーム画面から得られる情報とサウンドから得られる情報だけを受け取り、キーボードとマウス操作を行うことで、GCC(General Computer Control)の可能性を確認するのが目的となっている。

これまで囲碁や将棋はもちろん、MOBAやRTS、レースゲームも攻略してきたAIだが、様々な課題を正しくクリアしなければならない「ミッション」、「ストーリーに応じたゲームの進行」、NPCとの会話、オープンワールドでのアクションや探索など、非常に複雑な過程が必要になる『レッドデッドリデンプション2』が実験対象に選ばれた。

テキストの認識に加えて画像や音声の認識も可能な大規模言語モデルのGPT-4Vが使用された。

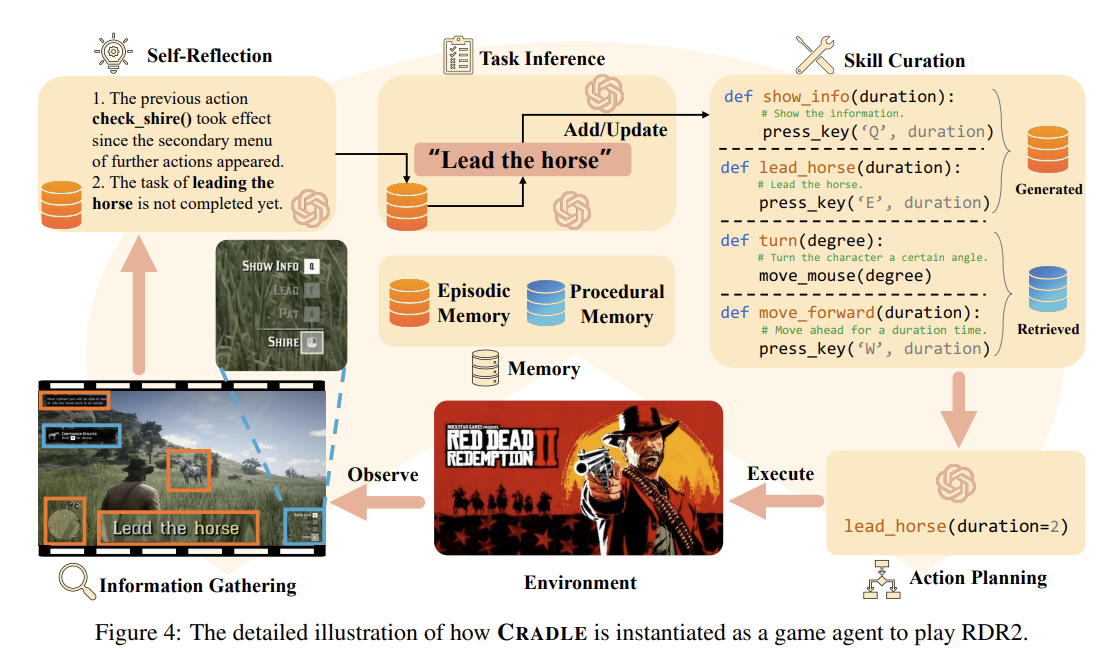

CRADLEとGPT-4Vは次のような流れで情報を分析、行動を実行している。

実験の結果、AIはレッドデッドリデンプション2のチャプター2の途中まで進むことに成功したという。

しかし、クエストの途中の銃撃戦や、複雑な建物内を捜索するといったミッションで困難を極めたという。また、「NPCから物を買う」というタスクも苦手としていた。

一方で、銃を取り出さなければならない場面で最初にナイフを取り出してしまった際、セルフリフレクションモジュールによって、間違った行動を取ったことをAIが自己認識し、武器をナイフから銃に変更することに成功したようだ。

今回の実験の課題の一つはGPT-4Vの空間認識能力にあるという。

環境フィードバックが不足すると、行動の意図とゲーム側の命令の意味が違った時にAIは状況を推察することが難しくなるようだ。

GPT-4Vは画像認識機能があるが、空間情報を精査する能力が不足しており、ショットガンを取るというタスクが与えられたものの、近くまで移動してからショットガンを取ることができなかった。また、画面に表示されるキーボードのアイコンやミニマップの情報を正しく読み取ることができていなかったという。

下の画像では、店員NPCの位置を認識することに失敗しており、左奥にいるNPCの位置を「右側」と表示してしまっている。

現時点では、APIに頼らずにゲームの内容を0から学習して実行に移すことに関しては、レッドデッドリデンプション2ほど複雑だと様々な課題が生まれたようである。しかし、チュートリアルとして様々なガイド情報が表示されるチャプター1をクリアするだけの能力はあるようだ。

研究グループによると、大規模言語モデルを利用したAIがAAAゲームのミッションをクリアできたのは史上初とのこと。

CRADLEがクリアできたチャプター1のタスクの一部。

ソース: tom’s Hardware

コメント